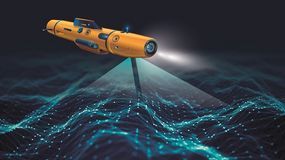

Das Hauptziel von DeeperSense ist die signifikante Verbesserung der Fähigkeiten zur Umgebungswahrnehmung von Service Robotern, um deren Leistung und Zuverlässigkeit zu erhöhen, neue Funktionen zu erreichen und neue Anwendungen für die Robotik zu erschließen. DeeperSense verfolgt einen neuartigen Ansatz, um Künstliche Intelligenz bzw. datengetriebenes maschinelles Lernen / DeepLearning zu nutzen um die Funktionen von nicht-visuellen und visuellen Sensoren zu kombinieren, mit dem Ziel, ihre gemeinsame Fähigkeit der Umgebungswahrnehmung über die Fähigkeiten der einzelnen Sensoren hinaus zu verbessern. Als eines der anspruchsvollsten Anwendungsgebiete für Robotereinsätze und Umgebungswahrnehmung wählt DeeperSense die Unterwasserrobotik als Domäne um diesen Ansatz zu demonstrieren und zu verifizieren. Das Projekt implementiert DeepLearning-Lösungen für drei Anwendungsfälle, die aufgrund ihrer gesellschaftlichen Relevanz ausgewählt wurden und von konkreten Endanwender- und Marktbedürfnissen getrieben sind. Während des Projekts werden umfangreiche Trainingsdaten generiert. Die Algorithmen werden auf diesen Daten trainiert und sowohl im Labor als auch in umfangreichen Feldversuchen verifiziert. Die trainierten Algorithmen werden so optimiert, dass sie von der On-Board-Hardware der Unterwasserfahrzeuge genutzt werden können um autonomes Roboterverhalten in Echtzeit zu unterstützen . Sowohl die Algorithmen als auch ein Teil der Trainingsdaten werden über Online-Datenbanken, die in den europäischen Forschungsinfrastrukturen eingebettet sind, öffentlich zugänglich gemacht.

Das DeeperSense-Konsortium beinhaltet erfahrene Experten für Robotik und Meeresrobotik, künstliche Intelligenz und Unterwassersensorik. Die Forschungs- und Technologiepartner werden durch Endanwender aus den drei Anwendungsbereichen ergänzt.

Die Verwertungsstrategie von DeeperSense hat unter anderem das Ziel, die Lücke zwischen den europäischen Robotik- und KI-Gemeinschaften zu schließen und so die europäische Wissenschaft und Technologie zu stärken.

Partner

UNIVERSITAT DE GIRONA (ES) UNIVERSITY OF HAIFA (IL) KRAKEN ROBOTIK GMBH (DE) BUNDESMINISTERIUM DES INNERN (THW) (DE) ISRAEL NATURE AND NATIONAL PARKS PROTECTION AUTHORITY (IL) TECNOAMBIENTE SL (ES)