|

|||||

|

|

|

|

|||

|

Wer des öfteren mehrfach den gleichen Brief von

ein und demselben Absender nur mit leichten Variationen in der Adressschreibweise

bekommt, wird sich schon gefragt haben, ob Computer eigentlich noch

nicht in der Lage sind, solche Duplikate zu erkennen. Der Grund für

die Brief-Dubletten: die Adressdaten sind meistens lediglich als Text-Zeilen

abgespeichert, deren Struktur - z.B. Name, Straße/Platz, Stadt

- von der Maschine nicht registriert wird. Wären diese Daten in

der Internet-Sprache XML (eXtensible Markup Language, erweiterbare Auszeichnungssprache)

abgelegt, könnten Adressen strukturell verglichen und die meisten

Dubletten automatisch erkannt und aussortiert werden.

Firmen können

aus XML-codierten Web-Seiten ein zentrales Wissensarchiv („Unternehmensgedächtnis“)

aufbauen und pflegen und sich die verschiedenen Darstellungsformen z.B.

für HTML-Browser oder für WML- Handys (Wireless Markup Language)

automatisch generieren lassen. Während in HTML, welches lediglich

das Layout von Web-Dokumenten definiert, alle Varianten der Seiten immer

neu angepasst werden müssen, genügt bei XML eine einzige Änderung

im zentralen Wissensarchiv, aus dem sodann mühelos alle anderen

Darstellungsformen automatisch mit Transformationssprachen wie XSLT

neu generiert werden können. Darüber hinaus können Suchmaschinen

oder Netzwerkagenten direkt auf der XML-Struktur arbeiten, die um ein

Vielfaches leichter ausgewertet werden kann als HTML-Layouts oder WML. |

|

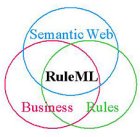

Einen

entscheidenden Schritt über XML hinaus geht die im Februar vom

W3C gestartete Aktivität zur Schaffung eines semantischen Webs.

Die dritte Ebene nach Layout (HTML) und Struktur (XML) ist nämlich

der Inhalt von Web-Dokumenten. Zu dessen Erfassung werden derzeit auf

der Basis von XML weitere Sprachen (RDF, DAML+OIL) entwickelt, mit denen

Aspekte der Bedeutung von Daten beschrieben werden können. In diesen

Sprachen werden hierarchisch-klassifizierende Begriffssysteme oder Ontologien

aufgebaut, die von Web-Akteuren (menschlichen wie maschinellen) als

begriffliche Rahmensysteme geteilt werden. Am DFKI, das Mitglied

im W3C ist, wird intensiv an solchen Techniken für das Semantische

Web gearbeitet, um sie in Kundenprojekten umzusetzen. Prof. Wahlster:

„Das Semantische Web wird zur Basis für die dritte Generation

von globalen Internet-Anwendungen, die endlich eine präzise inhaltliche

Suche erlauben und Webinhalte maschinell verarbeitbar machen. Wer diesen

Megatrend verpasst und auf der XML-Stufe stehen bleibt, wird kein Wachstum

im Internet-Umfeld realisieren können.“ Dr. Harold Boley

rief die internationale Rule Markup Initiative ins Leben, welche die

Sprache RuleML (Rule Markup Language) definiert hat und sich weiterhin

für die vereinheitlichte Speicherung, Suche, Integration und Aktivierung

von Regelwissen im Web einsetzt. Teilnehmer sind Universitäten

wie Stanford und MIT sowie Firmen wie Sun und IBM. RuleML (http://www.dfki.de/ruleml)

versucht alle Regelarten als Teilsprachen modular zu erfassen, die in

der Praxis - etwa von wissensbasierten Systemen, Intelligenten Agenten

oder E-Commerce - vorkommen. Die am 11. Juli fertig gestellte neue Version

kann gleichberechtigt auf der Basis von XML und RDF eingesetzt werden.

Eine Kooperation mit den Entwicklern von RDF und dem US-Europäischen

DAML+OIL ist angelaufen, um gemeinsam die gesamte Breite des Semantischen

Web abzudecken.

|

|||

Durch

den verstärkten Einsatz von XML wird künftig die maschinelle

Integration und Auswertung von Datenbanken, Dokumentarchiven und Web-Seiten

nicht nur erleichtert und qualitativ verbessert; der Einsatz dieses

internationalen Sprachstandards kann gleichzeitig auch zur erheblichen

Kostenreduzierung beitragen. Die vom World-Wide-Web-Consortium (W3C)

in den USA entwickelte „Meta-Sprache“ erlaubt die Definition

von neuen Spezialsprachen („XML-Applikationen“) zur Strukturierung

aller erdenklichen Anwendungsbereiche. Im Bereich der Chemie in Wissenschaft

und Wirtschaft wurde CML (Chemical Markup Language) - wohl die erste

XML-Anwendung überhaupt - standardisiert und verbreitet sich seither

weltweit. Für das E-Business wird ebXML entwickelt, das einen globalen

elektronischen Marktplatz ermöglichen soll, auf dem sich Unternehmen

aller Größenordnungen und aller geographischen Orte treffen

und untereinander Handel betreiben können.

Durch

den verstärkten Einsatz von XML wird künftig die maschinelle

Integration und Auswertung von Datenbanken, Dokumentarchiven und Web-Seiten

nicht nur erleichtert und qualitativ verbessert; der Einsatz dieses

internationalen Sprachstandards kann gleichzeitig auch zur erheblichen

Kostenreduzierung beitragen. Die vom World-Wide-Web-Consortium (W3C)

in den USA entwickelte „Meta-Sprache“ erlaubt die Definition

von neuen Spezialsprachen („XML-Applikationen“) zur Strukturierung

aller erdenklichen Anwendungsbereiche. Im Bereich der Chemie in Wissenschaft

und Wirtschaft wurde CML (Chemical Markup Language) - wohl die erste

XML-Anwendung überhaupt - standardisiert und verbreitet sich seither

weltweit. Für das E-Business wird ebXML entwickelt, das einen globalen

elektronischen Marktplatz ermöglichen soll, auf dem sich Unternehmen

aller Größenordnungen und aller geographischen Orte treffen

und untereinander Handel betreiben können.